La peur de la LPD bloque plus que la LPD elle-même

Quand je discute avec des dirigeants suisses qui veulent automatiser une partie de leur admin, la question tombe presque toujours dans les cinq premières minutes. « Et la LPD, on fait comment ? » Derrière cette question, il y a rarement une lecture attentive de la loi. Il y a une angoisse diffuse, alimentée par des articles alarmistes et par l'idée que toucher à l'IA avec des données clients, c'est forcément jouer avec le feu.

Je comprends cette peur. Je l'ai eue moi-même quand j'ai commencé à travailler sur des flux d'automatisation qui manipulaient des données personnelles. J'ai passé des heures à lire la nLPD, entrée en vigueur le 1er septembre 2023 selon le PFPDT, et à chercher la ligne rouge à ne pas franchir. Ce que j'ai trouvé, c'est que la ligne rouge n'est pas là où la plupart des gens l'imaginent. La loi ne dit pas « n'utilisez pas l'IA ». Elle dit « sachez ce que vous faites avec les données, pourquoi vous le faites, et protégez les personnes concernées ». C'est très différent.

Le vrai pattern que j'observe, c'est celui-ci. Des entreprises qui n'ont jamais formalisé quelles données clients elles collectent, où elles les stockent, qui y accède. Elles fonctionnaient comme ça depuis des années sans problème apparent. Et quand l'IA entre dans la conversation, soudain la conformité devient un sujet. L'IA n'a pas créé le problème. Elle l'a rendu visible.

Ce que la nLPD exige vraiment quand tu branches de l'IA

Soyons directs. La nLPD ne mentionne pas l'intelligence artificielle. Elle encadre le traitement de données personnelles, quel que soit l'outil. Si tu utilises un tableur Excel partagé sur OneDrive avec des noms de clients dedans, tu es déjà soumis aux mêmes obligations que si tu fais tourner un workflow automatisé. La différence, c'est que l'automatisation traite plus vite et plus de volume, ce qui amplifie les conséquences d'une erreur.

Trois points méritent ton attention. D'abord, la finalité. Tu dois savoir pourquoi tu traites ces données et ne pas les utiliser pour autre chose. Ensuite, la proportionnalité. Tu ne collectes que ce dont tu as besoin. Enfin, la transparence. Les personnes concernées doivent pouvoir savoir ce que tu fais de leurs données. L'article 60 de la nLPD prévoit des amendes jusqu'à 250'000 francs en cas de violation intentionnelle. Le mot « intentionnel » compte. Ce n'est pas une erreur technique qui te coûtera ça, c'est le fait de savoir que tu fais n'importe quoi et de continuer.

Là où ça se complique pour de vrai, c'est le transfert de données à l'étranger. Si ton outil IA envoie des données clients sur des serveurs américains sans base juridique adéquate, tu as un vrai sujet. J'ai détaillé les enjeux d'hébergement dans cet article sur la confidentialité et l'hébergement des données IA en Suisse. C'est souvent le point le plus mal compris, et celui qui génère le plus de risque réel.

Les trajectoires que je vois chez ceux qui avancent

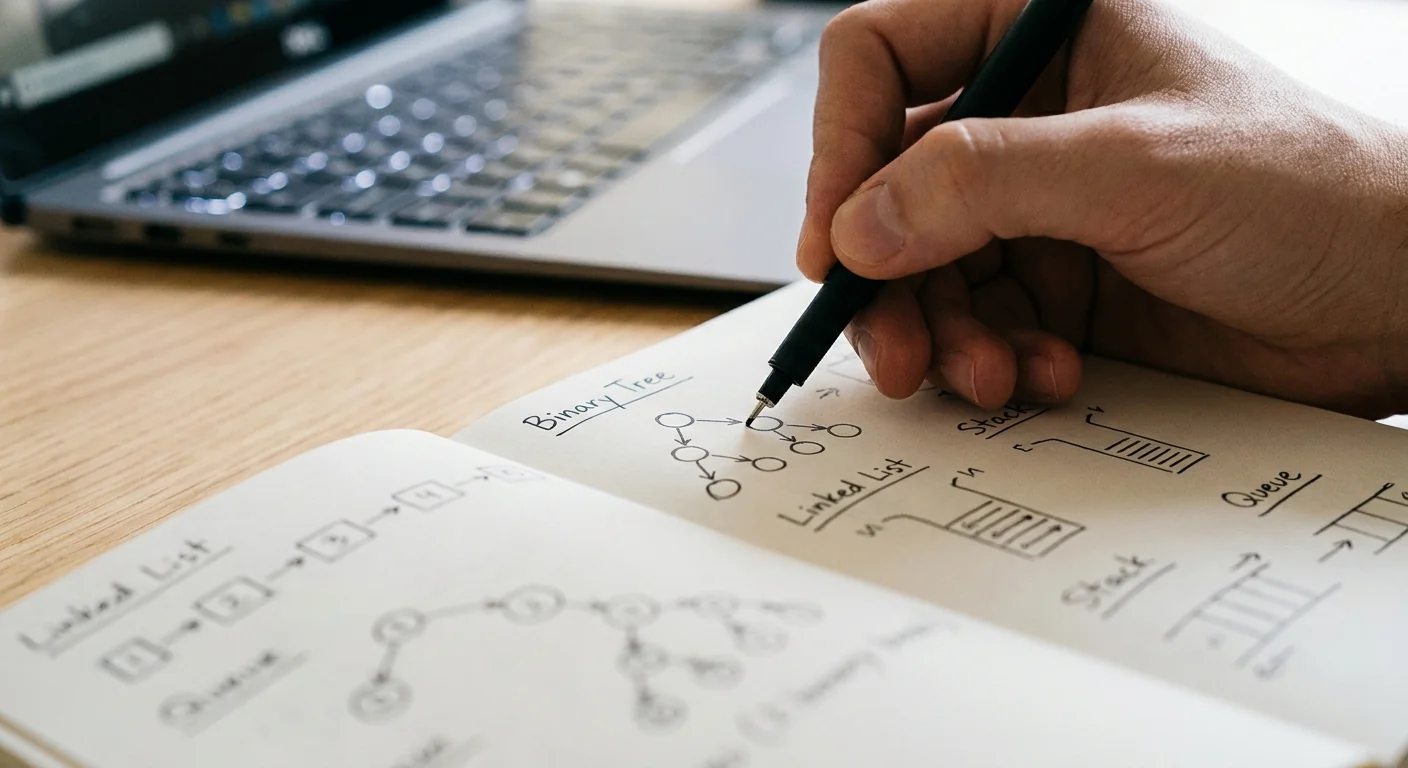

Il y a un schéma qui revient chez les entreprises qui arrivent à utiliser l'IA sans se mettre en danger sur la conformité. Elles ne commencent pas par l'outil. Elles commencent par cartographier leurs flux de données. Ça semble ennuyeux, et ça l'est. Mais sans cette étape, tu ne sais pas ce que tu exposes quand tu connectes un nouvel outil.

Fais le calcul toi-même. Prends le nombre de formulaires ou de points de collecte de données clients dans ton entreprise. Multiplie par le nombre de systèmes où ces données transitent, CRM, email, facturation, support. Si tu arrives à plus de 10 combinaisons et que tu ne peux pas dire avec certitude où chaque donnée finit, tu as ton premier chantier. Pas besoin d'IA pour ça, juste d'un tableur et de deux heures de lucidité.

Ceux qui passent cette étape découvrent souvent que le périmètre à automatiser est plus petit qu'ils ne le pensaient, et c'est une bonne nouvelle. Automatiser trois flux bien définis avec des données maîtrisées, c'est infiniment plus sûr et plus utile que de brancher un outil IA sur tout le système d'information en espérant que ça tienne. J'ai fait cette erreur moi-même il y a quelques années, vouloir aller trop large trop vite. Le résultat a été un projet qu'il a fallu démonter à moitié pour reconstruire proprement.

Arrête d'attendre la certitude, commence par la clarté

La tentation la plus courante, c'est d'attendre. Attendre que la réglementation se stabilise, qu'un prestataire propose une « solution conforme clé en main », que quelqu'un d'autre essuie les plâtres. Le problème, c'est que pendant ce temps, tes concurrents qui ont pris le sujet à bras le corps gagnent du temps chaque semaine sur des tâches que tu fais encore à la main.

La conformité LPD n'est pas un état binaire. Ce n'est pas « conforme » ou « hors la loi ». C'est un processus continu de clarification. Et cette clarification, elle a de la valeur bien au-delà du juridique. Quand tu sais exactement quelles données tu traites, pourquoi, et comment, tu prends de meilleures décisions sur tout le reste. Sur tes outils, sur tes processus, sur ce que tu délègues à une machine et ce que tu gardes en humain.

Si tu veux avancer sans te noyer, commence par un périmètre restreint. Un seul processus, avec des données que tu maîtrises, hébergé en Suisse. Teste. Apprends. Élargis ensuite. C'est exactement l'approche qu'on propose dans nos services d'automatisation IA à Lausanne. Pas parce que c'est la plus spectaculaire, mais parce que c'est la seule qui tient dans la durée quand tu dois rendre des comptes sur la protection des données de tes clients.