Ton recrutement actuel n'a rien d'objectif non plus

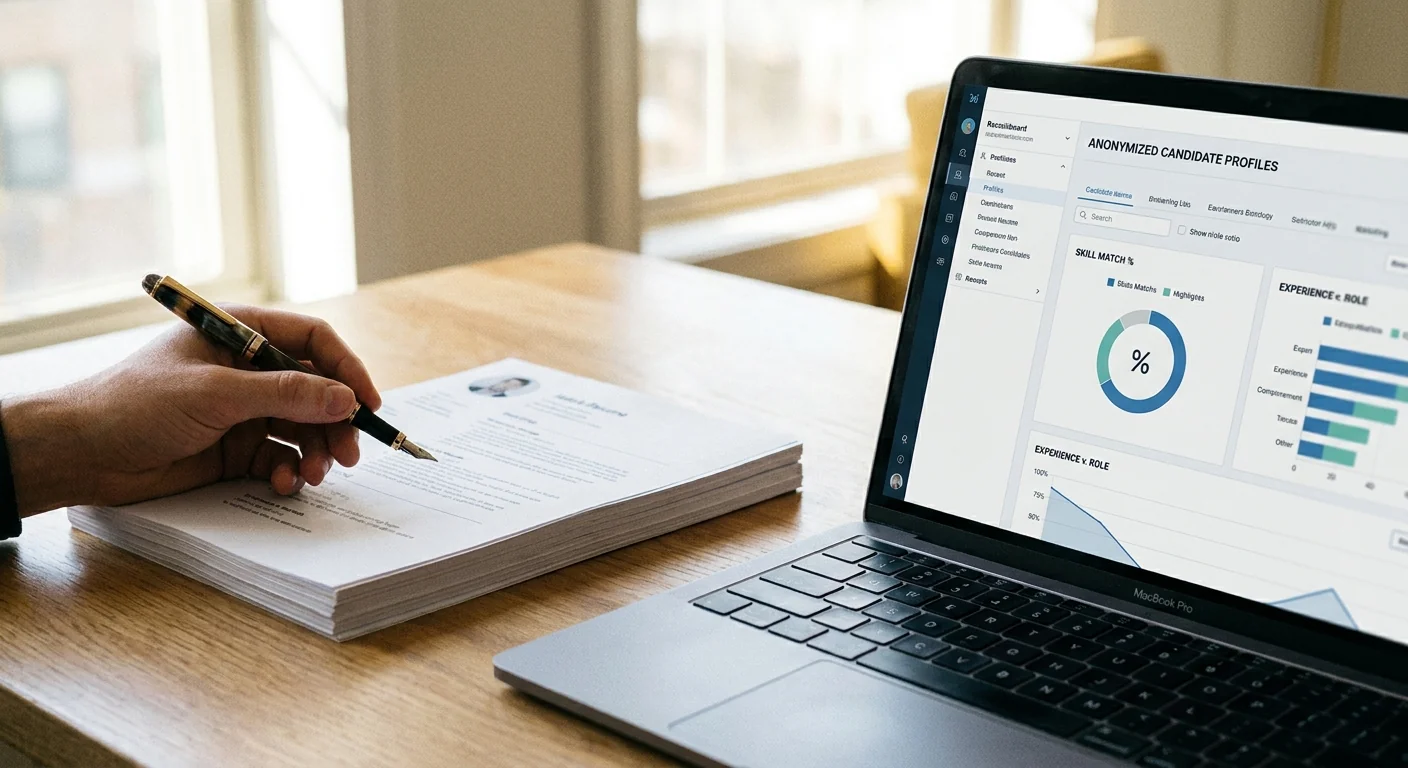

Quand on parle d'IA en RH, la première réaction est presque toujours la même. « Et si l'algorithme discrimine ? » La question est légitime. Mais elle masque un angle mort assez gênant. Ton processus de recrutement actuel, celui qui repose sur le jugement humain, n'a jamais été audité pour ses biais. Personne ne t'a jamais demandé de prouver que la pile de CV écartés en dix minutes un lundi matin l'a été sur des critères objectifs.

On sait, grâce à des études reproduites dans plusieurs pays, que le prénom sur un CV influence la probabilité d'être rappelé. Que la photo joue. Que l'école mentionnée active des réflexes de familiarité. Tout ça se passe dans la tête d'un humain, pas dans un algorithme. La différence avec une IA, c'est qu'un algorithme, lui, laisse une trace. Tu peux l'auditer, le corriger, le contraindre. Un feeling de recruteur à 8h du matin après un mauvais café, non. Alors avant de poser la question « où placer la limite éthique de l'IA en RH », il faudrait peut-être se demander où on a placé la limite éthique du recrutement sans IA. La réponse, dans la plupart des entreprises de 15 à 50 personnes, c'est nulle part.

Le biais algorithmique existe, mais il est traçable

Je ne dis pas que l'IA est neutre. Un algorithme entraîné sur des données historiques de recrutement va reproduire les schémas qu'il trouve dans ces données. Si pendant dix ans tu n'as recruté que des profils similaires, l'IA va favoriser ce même profil. C'est un vrai problème. Mais c'est un problème qu'on peut voir, mesurer et corriger.

Fais le calcul sur ta propre boîte. Prends tes vingt derniers recrutements. Note le genre, l'âge approximatif, la formation, l'origine géographique des personnes retenues. Puis fais la même chose pour les candidatures reçues. Si les proportions divergent fortement, tu as un biais. Humain, pas algorithmique. Un outil d'IA, lui, peut être configuré pour signaler exactement ce type de déséquilibre. Il peut même refuser de scorer un critère que tu lui interdis de prendre en compte. Essaie de demander la même discipline à un cerveau humain fatigué qui trie 80 dossiers avant midi.

Le paradoxe, c'est que l'IA rend le biais visible. Et c'est précisément cette visibilité qui fait peur. On préfère un système opaque mais « humain » à un système transparent mais « machine ». C'est compréhensible émotionnellement. Mais d'un point de vue éthique, c'est difficile à défendre.

La LPD suisse t'oblige déjà à plus de rigueur que tu ne crois

La nouvelle Loi sur la Protection des Données, entrée en vigueur le 1er septembre 2023 selon le Préposé fédéral à la protection des données et à la transparence (PFPDT), impose des obligations claires sur le traitement des données personnelles. Les articles 6 et suivants de la LPD (RS 235.1) exigent transparence et minimisation des données. Si tu utilises un outil d'IA pour filtrer des CV, tu dois pouvoir expliquer quels critères sont utilisés et sur quelle base les décisions sont prises. Tu dois aussi informer les candidats que leurs données sont traitées de manière automatisée.

Mais voilà ce qu'on oublie souvent. Ces mêmes obligations s'appliquent en théorie à tout traitement de données de candidats, même manuel. Si tu stockes des CV dans un dossier partagé sans politique de conservation, si tu échanges des avis sur des candidats par email sans base légale claire, tu es déjà en zone grise. L'IA ne crée pas le problème juridique. Elle le rend impossible à ignorer. Et c'est tant mieux, parce que la Constitution fédérale (art. 8) et la Loi sur l'égalité (LEg, RS 151.1) interdisent la discrimination, que la décision vienne d'un humain ou d'une machine. Si tu veux approfondir la question de l'hébergement et du traitement des données en Suisse, la question de la confidentialité des données et de l'hébergement mérite qu'on s'y arrête sérieusement.

L'évaluation des collaborateurs par l'IA, là où ça coince vraiment

Le recrutement capte toute l'attention médiatique. Mais la zone la plus sensible, c'est l'évaluation des collaborateurs déjà en poste. Utiliser l'IA pour noter la performance, identifier les « hauts potentiels » ou prédire les départs, ça touche des gens qui travaillent avec toi tous les jours. Qui te font confiance. Qui n'ont pas signé pour être scorés par un algorithme.

Ici, la limite éthique ne se joue pas dans la technologie. Elle se joue dans la gouvernance. Qui voit les résultats ? Qui prend la décision finale ? Le collaborateur sait-il qu'il est évalué par un outil automatisé ? A-t-il un recours ? Dans une entreprise de 15 à 50 personnes, ces questions ne sont pas abstraites. Elles se posent entre quatre yeux, dans un bureau, avec quelqu'un que tu croises à la machine à café. Si tu veux que ton équipe accepte l'IA dans les processus RH, il faut que la transparence soit totale. Pas un document PDF de 40 pages que personne ne lit, mais une conversation claire sur ce que l'outil fait, ce qu'il ne fait pas, et qui reste aux commandes. Former ton équipe aux outils d'IA n'est pas un luxe dans ce contexte. C'est la condition pour que ça tienne.

Remettre l'humain aux commandes, pas aux commandes de rien

La phrase « l'humain doit rester au centre » est devenue un réflexe verbal qui ne veut plus rien dire. Tout le monde la prononce. Personne ne la définit. Remettre l'humain aux commandes, ça signifie quelque chose de très précis. Ça veut dire que chaque décision RH qui affecte une personne, embauche, promotion, licenciement, doit être prise par un être humain qui peut l'expliquer et l'assumer. L'IA peut trier, suggérer, alerter. Elle ne décide pas.

Et c'est là que ma position va peut-être froisser. Je pense qu'une entreprise qui utilise l'IA avec des règles claires, une supervision humaine et un droit de regard pour les personnes concernées est plus éthique qu'une entreprise qui fait tout « à l'ancienne » sans jamais questionner ses propres biais. Le refus de l'IA n'est pas une position éthique par défaut. C'est parfois juste du confort. Se dire « on fait les choses bien parce qu'on les fait nous-mêmes » sans preuve, c'est exactement le genre de certitude que l'éthique est censée bousculer.

Si tu diriges une boîte en Suisse romande et que tu veux moderniser tes processus RH sans sacrifier tes valeurs, commence par regarder tes pratiques actuelles avec la même exigence que celle que tu appliquerais à un algorithme. Mesure tes propres biais. Documente tes critères de décision. Et ensuite seulement, demande-toi si un outil peut t'aider à faire mieux. La réponse sera probablement oui, mais elle n'aura de valeur que si tu as fait ce travail d'abord.